Виртуальная реальность помогает инженерам читать мысли роботов

Новая система визуализации сочетает потолочные проекторы с технологией захвата движения и анимационным ПО

В темном, похожем на ангар, 41-м здании Массачусетского технологического института, небольшой робот типа Roomba пытается обрести себя. На его пути препятствие — человек, который ходит туда-сюда. Чтобы попасть на другую сторону комнаты, робот сначала должен определить, где пешеход, затем выбрать оптимальный маршрут, чтобы избежать близкой встречи, пишет Hi-news.ru.

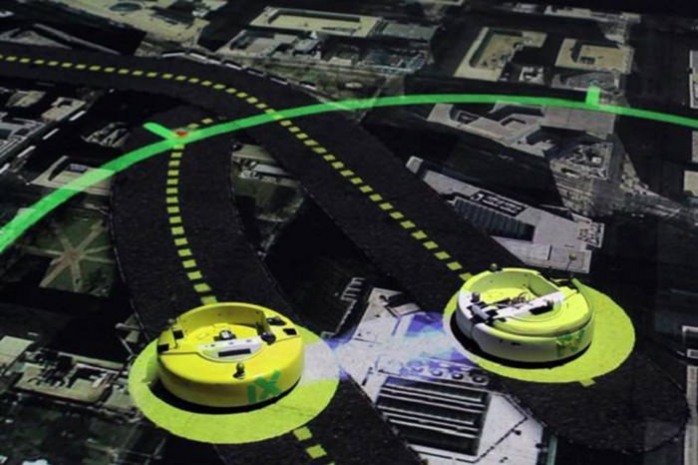

Пока робот осмысливает свои варианты, его «мысли» проецируются на землю: большая розовая точка появляется рядом с пешеходом — символ восприятия человека роботом, точнее его положения в пространстве. Линии, каждая из которых представляет возможный маршрут для робота, переплетаются по всей комнате извилистыми узорами, зеленым цветом горит оптимальный маршрут. Линии и точки сдвигаются и подстраиваются под движения робота и пешехода.

Эта новая система визуализации сочетает потолочные проекторы с технологией захвата движения и анимационным программным обеспечением для прогнозирования намерений робота в режиме реального времени. Исследователи назвали систему «измеряемой виртуальной реальностью» — вариант использования обычной виртуальной реальности для визуализации «восприятия и понимания мира» роботом, как говорит Али-Акбар Ага-Мохаммади, постдок MIT.

«Как правило, робот может принять определенное решение, но вы не можете точно сказать, что происходит в его голове, когда он выбирает конкретный путь, — говорит он. — Но если вы видите план, проецируемый на землю, вы можете связать восприятие робота с его действиями во время принятия решений.

Ага-Мохаммади говорит, что такая система может ускорить развитие самодвижущихся автомобилей, доставляющих грузы дронов и других транспортных средств с автономным планированием маршрута.

«Как конструкторы, когда мы сравниваем восприятие робота с его действиями, мы можем найти ошибки в коде значительно быстрее, — говорит Ага-Мохаммади. — К примеру, если мы летаем на квадрокоптере и видим, что что-то идет не так, мы можем быстро исправить код до того, как устройство врежется в стену и разобьется».

Эта система была разработана Шайеганом Омидшафи, аспирантом Ага-Мохаммади. Вместе с коллегами они будут представлять систему визуализации в деталях на научной конференции Американского института аэронавтики и астронавтики в январе.

Изначально исследователи задумали систему визуализации как обратную связь для посетителей своей лаборатории. Во время демонстрации поведения робота людям зачастую было сложно понять, почему робот выбирает определенные пути.

«Некоторые из решений кажутся случайными», — говорит Омидшафи.

Команда разработала систему как способ визуального представления процесса принятия решений роботом. Инженеры установили 18 камер, отслеживающих движения, на потолке, с помощью которых можно наблюдать за множеством роботизированных устройств одновременно. Затем разработали программное обеспечение, которое визуально обрабатывает «скрытую» информацию вроде возможных путей движения робота и его восприятия препятствий. Далее они спроецировали эту информацию на землю в режиме реального времени.

Вскоре исследователи обнаружили, что проецируя намерения роботов, они также могут определить проблемы основных алгоритмов и вносить улучшения быстрее, чем раньше.

«Есть много проблем, которые всплывают из-за неопределенности в реальном мире или по причине технических неполадок, и вот здесь наша система позволяет существенно сократить количество усилий, которые прилагаются к выявлению точных причин, — говорит Омидшафи. — Обычно физические и моделирующие системы разделяются. Вам нужно спускаться к самому нижнему уровню своего кода, разбирать его и пытаться выяснить, откуда берутся ошибки. Теперь у нас есть возможность показать простую информацию самым физическим образом, так что вам даже не нужно искать проблемы в коде или менять алгоритмы. Вы просто видите результаты работы и можете поправить их на месте, не тратя на это месяц».

Открывая двери

Группа разработала несколько применений подобной системы визуализации. В одном из сценариев команда рассматривала роль дронов в борьбе с лесными пожарами. Такие беспилотники могут в один прекрасный день быть использованы для наблюдения пожаров в разных лесных условиях, их идентификации и подбора лучшей системы тушения.

Чтобы воплотить в реальность противопожарные дроны, команда стала изучать возможность виртуально. В дополнение к проецированию намерений дронов, ученые научились также проецировать пейзажи для имитации внешней среды. В тестовых сценариях группа летала на физических квадрокоптерах над проекциями лесов, показанных с воздушной перспективы, чтобы дрон «решил», будто летает над верхушками деревьев. Затем ученые проецировали пожар на разные части пейзажа и учили квадрокоптеры делать снимки местности, которые впоследствии могут помочь роботам распознавать признаки особо опасного пожара.

Забегая вперед, Ага-Мохаммади говорит, что команда планирует использовать свою систему для испытаний беспилотной доставки. С этой целью они будут имитировать городскую среду, создавая уличный вид, похожий на увеличенную перспективу Google Maps.

«Представьте, что мы можем спроецировать кучу домов в Кембридже, — говорит Ага-Мохаммади. — В зависимости от того, где находится транспорт, вы сможете взглянуть на окружающую среду с разных точек зрения, и то, что он увидит, будет очень похоже на то, что вы могли бы увидеть, летая в реальности».

Поскольку Федеральное управление гражданской авиации уже наложило ограничения на открытое тестирование квадрокоптеров и других автономных летающих аппаратов, Омидшафи отмечает, что испытание подобных устройств в виртуальной среде может быть панацеей. По сути, нет никакого ограничения на типы виртуальных сред, которые можно проецировать.

«С помощью этой системы вы можете создать любую среду, какую захотите, и протестировать свои аппараты в комнатных условиях, прежде чем разворачивать в реальном мире».

Смотрите также:

+10

+10